DeepSeek开源第一弹:6小时收藏破5000次,利好国产GPU?投资人:国产卡的推理性能提升将顺理成章

2月24日,在上周DeepSeek宣布本周将是开源周(OpenSourceWeek),并将连续开源五个软件库后。今日上午9:30时许,DeepSeek宣布开源了本次开源周首款代码库——针对Hopper GPU进行优化的高效型MLA解码核——FlashMLA。

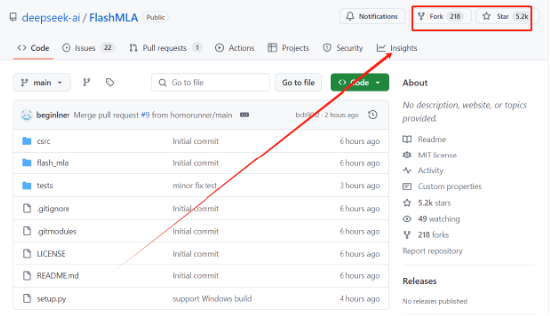

新浪科技注意到,在GitHub上,目前该项目开源6小时后便已收获了超过5000Star收藏,并且拥有188个Fork(副本创建)。在听到DeepSeek开源FlashMLA并迎来的快速的Star收藏和Fork数据增长后,某上市公司CTO在与新浪科技沟通中直呼:“太强了”。

另有专注于AI硬件研究并投资的投资人,在查看FlashMLA后告诉新浪科技,对于国产GPU而言,此次开源算是重大利好。“此前的国产GPU卡,很弱。那现在可以通过FlashMLA提供的优化思路和方法论,尝试让国产卡大幅提升性能,即使架构不同,后面国产卡的推理性能提升将是顺理成章的事儿”。

据DeepSeek官方介绍,FlashMLA基于Hopper GPUs的有效MLA解码内核,可针对可变长度序列进行优化。

在DeepSeek整个技术路线中,MLA(多头潜在注意力机制)是公司已经发布的V2、V3两款模型中,最为核心的技术之一。被用于解决计算效率和内存占用上的性能瓶颈,能够显著提升模型训练和推理效率,同时保持甚至增强模型性能。

展开全文

此前,中国工程院院士、清华大学计算机系教授郑纬民在与新浪科技沟通中曾提及:“DeepSeek自研的MLA架构为其自身的模型训练成本下降,起到了关键作用。”他指出,“MLA通过改造注意力算子压缩了KV Cache大小,实现了在同样容量下可以存储更多的KV Cache,该架构和DeepSeek-V3模型中FFN 层的改造相配合,实现了一个非常大的稀疏MoE 层,成为DeepSeek训练成本低最关键的原因。”

此次DeepSeek直接开放MLA解码核——FlashMLA,意味着DeepSeek将最为核心的MLA底层代码直接免费开放,这让广大开发群体可以直接复用FlashMLA代码库实现用更少的GPU服务器完成同样的任务,直接降低推理成本,这对于更多希望基于DeepSeek开源能力进行底层优化和AI应用开发群体而言,无疑是一大福利。

有意思的是,DeepSeek此次开放的MLA解码核,主要是针对Hopper GPU进行优化用途的。通常而言,Hopper GPU是指基于英伟达Hopper架构研发的H系列GPU产品。目前,英伟达该系列芯片已经发布H100、H800和H20等多款芯片。

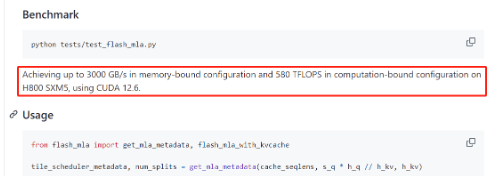

据DeepSeek方面介绍,在基准测试性能表现上,FlashMLA在英伟达H800 SXM5 GPU上可实现3000 GB/s 的内存速度以及580TFLOPS的计算上限。

公开资料显示,根据美国出口管制规定,H800的带宽上限被设定为600 GB/s,相比一些旗舰产品有所降低。这意味着,使用FlashMLA优化后,H800的内存带宽利用率有望进一步提高甚至突破H800 GPU理论上限,在内存访问上达到极致,能让开发群体充分“压榨”英伟达H系列芯片能力,以更少的芯片实现更强的模型性能,最大化GPU价值。

有专注于AI硬件研究并投资的投资人在查看FlashMLA后表示,“FlashMLA是能让LLM在H800跑得更快、更高效的优化方案,尤其适用于高性能AI任务,他的核心是加速大语言模型的解码过程,提高模型的响应速度和吞吐量,这对于实时生成任务(如聊chatbot等)非常重要,对于大模型的能力和使用体验是巨大的促进,速度会明显提升。”

虽然FlashMLA是一个针对Hopper GPU的优化代码库,但对于国产GPU而言,此次开源也有利好。上述投资人在查看FlashMLA后表示,对于国产GPU而言,此次开源算是重大利好。“此前的国产GPU卡,很弱。那现在可以通过FlashMLA提供的优化思路和方法论,尝试让国产卡大幅提升性能,即使架构不同,后面国产卡的推理性能提升将是顺理成章的事儿”。

来源:新浪网

【免责声明】本文仅代表作者本人观点,与和讯网无关。和讯网站对文中陈述、观点判断保持中立,不对所包含内容的准确性、可靠性或完整性提供任何明示或暗示的保证。请读者仅作参考,并请自行承担全部责任。邮箱:news_center@staff.hexun.com

评论

爱思助手

回复支持一下!https://www.aisizs.com/

爱思助手

回复楼主的文笔不错!https://www.aisizs.com/

LINE下载

回复收藏了,以后可能会用到!https://www.linewb.com/

爱思助手电脑版下载

回复信楼主,考试不挂科!https://www.aisizs.com/

Clash

回复哥回复的不是帖子,是寂寞!https://www.clashis.com/

搜狗输入法下载

回复小弟默默的路过贵宝地~~~https://www.sougoui.com/

快连下载

回复每次看到楼主的帖子都有惊吓!https://www.klianvpn.com/

快连下载

回复看了这么多帖子,第一次看到这么经典的!https://www.klianvpn.com/

WhatsApp下载

回复这个帖子会火的,鉴定完毕!https://www.whatsappwm.com/

爱思助手电脑版下载

回复经典!https://www.aisizs.com/

LINE网页版

回复这篇文章真是让人受益匪浅!https://www.linewb.com/

WhatsApp网页版

回复谢谢楼主的分享!https://www.whatsappwm.com/

Clash

回复信楼主,得永生!https://www.clashis.com/

LINE下载电脑版

回复楼主最近很消极啊!https://www.linewb.com/

WhatsApp

回复这么版块的帖子越来越有深度了!https://www.whatsappwm.com/

爱思助手

回复我只是来赚积分的!https://www.aisizs.com/

爱思助手电脑版

回复楼主的帖子提神醒脑啊!https://www.aisizs.com/

搜狗输入法下载

回复支持一个https://www.sougoui.com/

搜狗输入法电脑版下载

回复支持一下,下面的保持队形!https://www.sougoui.com/

爱思助手电脑版

回复视死如归的架势啊!https://www.aisizs.com/

LINE下载

回复终于看完了,很不错!https://www.linewb.com/

LINE电脑版下载

回复我只是来赚积分的!https://www.linewb.com/

WhatsApp下载

回复突然觉得楼主说的很有道理,赞一个!https://www.whatsappwm.com/

LINE下载

回复今天的心情很不错啊https://www.linewb.com/

快连VPN下载

回复勤奋灌水,天天向上!https://www.klianvpn.com/

搜狗输入法下载电脑版

回复文章论点明确,论据充分,说服力强。https://www.sougoui.com/

搜狗输入法下载

回复精华帖的节奏啊!https://www.sougoui.com/

Clash下载电脑版

回复太邪乎了吧?https://www.clashis.com/

Clash电脑版下载

回复感觉不错!https://www.clashis.com/

搜狗输入法电脑版下载

回复今天过得很不爽!https://www.sougoui.com/